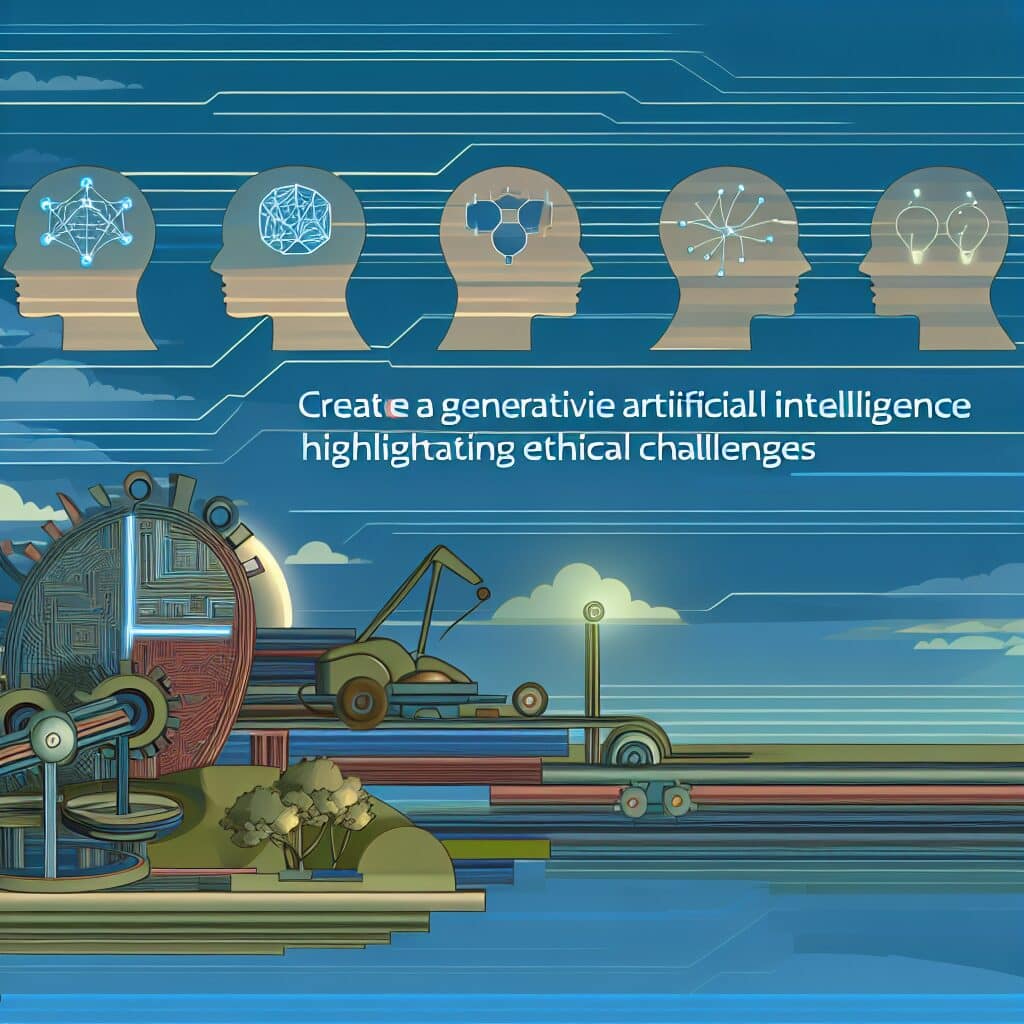

À l’heure où les technologies d’intelligence artificielle transforment notre quotidien à une vitesse fulgurante, l’IA générative s’impose comme la révolution numérique la plus significative de notre décennie. Mais alors que nous nous émerveillons devant les prouesses de ChatGPT, DALL-E ou Midjourney, des questions essentielles se posent pour notre avenir collectif. Comment allons-nous naviguer dans ce nouveau monde où la frontière entre création humaine et machine s’estompe chaque jour davantage ?

En 2023-2024, nous avons assisté à une démocratisation sans précédent des technologies génératives. Mais 2025 s’annonce comme l’année charnière où nous devrons affronter des défis éthiques majeurs. Dans cet article, nous explorerons les 5 défis éthiques révolutionnaires qui façonneront notre relation avec l’IA créative en 2025.

Table des matières

Qu’est-ce que l’IA générative et pourquoi son impact est-il si important en 2025 ?

L’intelligence artificielle générative désigne un ensemble de technologies capables de créer du contenu original – qu’il s’agisse de textes, d’images, de sons ou de vidéos – en s’inspirant des données sur lesquelles elles ont été entraînées. Contrairement aux IA traditionnelles qui analysent ou classifient des informations existantes, les modèles génératifs peuvent produire du contenu entièrement nouveau.

En 2025, les grands modèles de langage (LLM) comme GPT-4, Claude et Gemini, ainsi que les générateurs d’images comme DALL-E et Midjourney, atteindront un niveau de sophistication inédit. Selon les prévisions de Gartner, plus de 80% des entreprises exploiteront des outils IA générative d’ici fin 2025, contre moins de 5% en 2022. Cette adoption massive transformera radicalement des secteurs entiers :

- Création de contenu et médias

- Développement logiciel et programmation

- Santé et recherche médicale

- Éducation et formation

- Services financiers

L’arrivée des modèles multimodaux, capables de comprendre et générer simultanément du texte, des images, des sons et des vidéos, marquera un tournant décisif dans cette évolution. Ces systèmes pourront interagir avec le monde de façon beaucoup plus naturelle et contextuelle.

Pour en savoir plus sur l’impact de l’IA dans le domaine médical, consultez notre article sur les avancées de l’IA en santé pour 2025.

Comment les modèles d’IA générative fonctionnent-ils ?

Pour comprendre les défis éthiques qui nous attendent, il est essentiel de saisir les principes fondamentaux du fonctionnement de l’IA générative.

Au cœur de ces technologies se trouvent des architectures complexes comme les transformers, qui ont révolutionné le traitement du langage naturel. Ces systèmes utilisent des mécanismes d’attention pour comprendre les relations contextuelles entre les mots ou les pixels.

Le processus de création par IA en 4 étapes

- Apprentissage : Le modèle est entraîné sur d’immenses quantités de données (textes, images, sons)

- Compression : Ces informations sont transformées en embeddings dans un espace latent

- Génération : À partir d’un prompt (instruction), le modèle produit un contenu nouveau en suivant les patterns appris

- Affinage : Des techniques de fine-tuning permettent d’améliorer la qualité et la pertinence des résultats

En 2025, nous verrons émerger des modèles encore plus puissants grâce aux avancées en apprentissage profond génératif et en inférence générative. Les modèles de diffusion, qui créent progressivement du contenu en partant du bruit, et les réseaux antagonistes génératifs (GAN), qui opposent deux réseaux neuronaux pour améliorer la qualité, atteindront de nouveaux sommets de réalisme.

| Type de modèle | Applications principales | Exemples d’outils |

|---|---|---|

| Grands modèles de langage (LLM) | Génération de texte, conversation, code | GPT-4, Claude, Llama |

| Modèles de diffusion | Génération d’images et vidéos | DALL-E, Stable Diffusion |

| Modèles multimodaux | Applications combinant texte/image/audio | Gemini, GPT-4V |

Quels sont les risques de désinformation liés à l’IA générative en 2025 ?

Le premier défi éthique majeur concerne la désinformation massive rendue possible par ces technologies. En 2025, l’IA générative produira du contenu quasiment indiscernable de celui créé par des humains, soulevant des inquiétudes légitimes sur notre capacité à distinguer le vrai du faux.

Risques potentiels

- Deepfakes politiques manipulant les élections

- Fausses actualités indétectables

- Usurpation d’identité vocale pour fraudes

- Manipulation des marchés économiques

Solutions en développement

- Watermarking (filigrane numérique)

- Détecteurs d’hallucinations IA

- Réglementations sur la transparence

- Éducation aux médias renforcée

Selon un rapport du Forum Économique Mondial, la désinformation générée par IA figure parmi les 10 plus grands risques mondiaux pour la décennie à venir. Cette menace est particulièrement préoccupante dans un contexte où la confiance dans les institutions et les médias est déjà fragilisée.

La question de la désinformation est intimement liée aux avancées dans la connectivité mondiale. Découvrez comment la 5G amplifie ces enjeux dans notre article sur la 5G et les objets connectés.

Comment distinguer le contenu généré par IA du contenu humain ?

La détection du contenu généré par IA deviendra un enjeu crucial en 2025. Actuellement, les outils de détection comme GPTZero ou AI Content Detector présentent des taux d’erreur significatifs, surtout face aux modèles les plus récents.

Les chercheurs travaillent sur plusieurs approches complémentaires :

- Analyse statistique des patterns linguistiques typiques de l’IA

- Détection d’incohérences subtiles dans la logique ou le raisonnement

- Identification de signatures techniques invisibles à l’œil nu

Cependant, nous assistons à une véritable course à l’armement : plus les détecteurs s’améliorent, plus les modèles génératifs deviennent sophistiqués pour échapper à la détection. Cette dynamique rend l’éducation aux médias plus indispensable que jamais.

En 2025, la détection de contenu généré par IA deviendra probablement une fonctionnalité standard des navigateurs web et des plateformes de médias sociaux, offrant aux utilisateurs une indication claire de l’origine probable d’un contenu.

Comment garantir la transparence des sources dans l’ère de l’IA générative ?

Le deuxième défi éthique concerne la fiabilité et la traçabilité des informations dans un monde où l’IA générative est omniprésente. L’un des problèmes majeurs des modèles actuels est leur tendance aux « hallucinations » – c’est-à-dire présenter comme des faits des informations inexactes ou entièrement fabriquées.

« La capacité des modèles d’IA à citer leurs sources marque une évolution fondamentale vers une IA plus responsable. C’est la différence entre une boîte noire mystérieuse et un outil transparent. » – Dario Amodei, CEO d’Anthropic

En 2025, la question de la citation des sources deviendra centrale. Les utilisateurs exigeront de savoir sur quelles données les modèles d’IA fondent leurs réponses, particulièrement pour les informations sensibles ou spécialisées.

Plusieurs initiatives prometteuses émergent déjà :

- Claude (d’Anthropic) intègre la capacité de citer ses sources

- Perplexity AI combine recherche web en temps réel et génération de réponses

- Des modèles comme Bing Chat et Bard incluent des liens vers leurs sources

Un rapport de Stanford HAI souligne que 76% des utilisateurs d’IA générative considèrent la transparence des sources comme « très importante » ou « extrêmement importante » pour établir la confiance dans ces systèmes.

Pour les entreprises utilisant l’IA générative en entreprise, la traçabilité des informations sera essentielle pour éviter les risques juridiques et réputationnels. Dès 2025, nous pourrions voir apparaître des standards industriels et des certifications sur la transparence des sources en IA.

Quelles innovations technologiques vont améliorer la fiabilité des sources ?

Innovations technologiques pour une IA générative plus fiable

- RAG (Retrieval-Augmented Generation) : Cette technologie permet aux modèles d’IA de rechercher des informations à jour dans des bases de données externes avant de générer une réponse, limitant ainsi les hallucinations.

- Knowledge cut-off explicite : Les modèles indiquent clairement la date limite des informations sur lesquelles ils s’appuient.

- Vérification automatique des faits : Des systèmes spécialisés qui contrôlent en temps réel l’exactitude des informations générées.

- Interfaces utilisateur améliorées : Des designs qui mettent en évidence les sources et le degré de certitude des informations fournies.

Des recherches menées à l’Université Paris-Saclay montrent que les modèles intégrant des mécanismes de RAG réduisent les hallucinations de plus de 60% par rapport aux modèles standards, tout en améliorant la précision factuelle des réponses.

Cette évolution technique s’accompagnera d’une demande croissante pour des informations vérifiables et sourcées, tant de la part des utilisateurs que des régulateurs.

Dans quelle mesure l’IA générative va-t-elle transformer le marché du travail d’ici 2025 ?

Le troisième défi éthique concerne l’impact de l’IA générative sur l’emploi et les compétences. L’automatisation créative rendue possible par ces technologies va profondément remodeler le paysage professionnel dans de nombreux secteurs.

Selon une étude de McKinsey, d’ici 2025 :

- 15 à 30% des tâches dans 60% des métiers pourraient être automatisées par l’IA générative

- Les secteurs de la création de contenu, de la programmation et du service client seront les plus rapidement transformés

- La productivité globale pourrait augmenter de 3 à 5% grâce à ces technologies

Mais plutôt qu’un simple remplacement, nous assisterons à une profonde transformation des métiers existants et à l’émergence de nouvelles professions :

| Métiers transformés | Nouveaux métiers |

|---|---|

| Rédacteur augmenté par IA | Spécialiste en prompt engineering |

| Designer assisté par IA | Curateur de modèles IA |

| Développeur utilisant l’IA | Auditeur d’éthique IA |

| Chercheur augmenté | Facilitateur IA-humain |

Cette transition soulève des questions fondamentales d’équité et d’inclusion. Comment garantir que les bénéfices de cette révolution technologique soient largement partagés ? Comment accompagner les travailleurs dont les compétences risquent d’être obsolètes ?

En 2025, nous verrons s’accélérer le débat sur des mesures comme le revenu universel, la taxation des systèmes automatisés ou les programmes massifs de reconversion professionnelle.

L’impact de l’IA sur le travail est comparable à celui attendu dans les transports. Découvrez ces parallèles dans notre analyse sur l’essor des véhicules autonomes en 2025.

Comment se préparer professionnellement à l’ère de l’IA générative ?

Compétences clés pour l’ère de l’IA générative

- Maîtriser les prompts IA efficaces pour diriger ces outils avec précision

- Développer votre créativité stratégique et votre pensée critique

- Acquérir des compétences en éthique et gouvernance de l’IA

- Cultiver l’intelligence émotionnelle et les compétences relationnelles

- Se former continuellement aux nouvelles technologies

De nombreuses formations émergent dans ce domaine, des MOOC gratuits aux diplômes universitaires spécialisés. Des plateformes comme Coursera, EdX ou OpenClassrooms proposent déjà des programmes ciblés sur l’intelligence artificielle générative avec des exemples pratiques et des applications professionnelles.

Selon LinkedIn, les compétences en prompt engineering et en intégration d’IA générative figurent parmi les plus demandées en 2025, avec des salaires moyens supérieurs de 20 à 30% à ceux des postes équivalents sans ces compétences.

Comment protéger la propriété intellectuelle à l’ère de l’IA générative ?

Le quatrième défi éthique concerne les droits d’auteur et la propriété intellectuelle. L’IA générative soulève des questions juridiques et éthiques complexes : qui possède les droits sur un contenu créé par IA ? Les modèles peuvent-ils utiliser librement des œuvres protégées pour leur entraînement ?

Principaux procès liés à l’IA générative (2023-2024)

- Getty Images contre Stability AI : Utilisation non autorisée d’images protégées

- Auteurs (dont Sarah Silverman) contre OpenAI et Meta : Violation des droits d’auteur littéraires

- New York Times contre OpenAI et Microsoft : Utilisation de contenus journalistiques protégés

D’ici 2025, nous verrons émerger un cadre juridique plus clair. L’Union Européenne, avec son AI Act, prend déjà les devants en imposant des obligations de transparence sur l’utilisation d’œuvres protégées pour l’entraînement des IA.

Plusieurs approches sont envisagées pour équilibrer innovation et protection des créateurs :

- Systèmes de licences spécifiques pour l’entraînement des modèles d’IA

- Mécanismes de traçabilité des œuvres utilisées dans l’apprentissage

- Outils permettant aux créateurs de refuser l’utilisation de leurs œuvres

- Partage des revenus générés par les créations assistées par IA

La question de l’authentification de contenu deviendra également cruciale pour distinguer les créations humaines, assistées par IA ou entièrement générées par IA.

Quels modèles économiques émergent pour rémunérer équitablement les créateurs ?

Face à ces défis, de nouveaux modèles économiques se développent pour assurer une rémunération juste des créateurs :

- Marketplaces de prompts et de styles : Des plateformes où les artistes peuvent monétiser leurs styles distinctifs pour la génération d’images

- Licences d’entraînement : Des accords permettant aux développeurs d’IA d’utiliser des œuvres protégées moyennant compensation

- Systèmes de crédits créatifs : Lorsqu’une IA génère du contenu inspiré par un artiste spécifique, celui-ci reçoit automatiquement une part des revenus

- Modèles hybrides humain-IA : Des collaborations où l’IA amplifie le travail des créateurs humains qui conservent le contrôle créatif et les droits

Adobe, par exemple, a développé son modèle Firefly en n’utilisant que des contenus libres de droits ou sous licence, créant ainsi un précédent pour une IA générative respectueuse des droits d’auteur.

Ces questions de propriété intellectuelle rejoignent les innovations dans le domaine virtuel. Approfondissez ce sujet avec notre article sur les innovations en réalité virtuelle.

Comment assurer un accès équitable aux technologies d’IA générative dans le monde ?

Le cinquième défi éthique majeur concerne l’équité d’accès à ces technologies puissantes. En 2025, nous risquons de voir se creuser une nouvelle fracture numérique entre ceux qui peuvent exploiter les outils IA générative gratuits et les plus avancés, et ceux qui en sont exclus.

Facteurs d’inégalité

- Coûts énergétiques et infrastructurels élevés

- Barrières linguistiques et culturelles

- Concentration géographique des technologies

- Modèles économiques basés sur l’abonnement

Solutions pour l’inclusion

- Modèles open-source et locaux

- Diversification linguistique des modèles

- Technologies frugales et adaptées

- Formations accessibles et partagées

Selon l’UNESCO, moins de 30% de la population mondiale a actuellement accès à des outils IA générative performants, avec des disparités massives entre régions développées et en développement.

L’enjeu écologique est également crucial. L’empreinte carbone des grands modèles d’IA est considérable : l’entraînement d’un seul grand modèle peut émettre autant de CO2 que cinq voitures pendant leur durée de vie complète.

Ces questions environnementales sont étroitement liées aux défis technologiques verts. Découvrez-en plus dans notre analyse des technologies vertes dans l’industrie énergétique.

Quelles initiatives favorisent l’inclusion et la diversité dans le développement de l’IA ?

Face à ces défis, plusieurs initiatives prometteuses émergent pour démocratiser l’accès à l’IA générative :

| Type d’initiative | Description | Exemples concrets |

|---|---|---|

| Modèles open-source | Modèles IA librement disponibles et modifiables | Llama (Meta), BLOOM |

| Spécialisation linguistique | Développement pour langues sous-représentées | Masakhane, AfroLM |

| IA frugale | Modèles optimisés pour appareils limités | TinyML, MobileGPT |

| Programmes éducatifs | Formation accessible et inclusive | AI4All, UNESCO AI Schools |

Des organisations comme AI4All, UNESCO et Partnership on AI travaillent activement à rendre ces technologies plus inclusives et accessibles. Les gouvernements commencent également à développer des stratégies nationales pour ne pas laisser leur population à l’écart de cette révolution.

En France, par exemple, le plan d’IA souveraine prévoit des investissements significatifs dans la formation et le développement de capacités locales en IA générative.

Conclusion

À l’aube de 2025, l’IA générative nous place face à cinq défis éthiques majeurs qui façonneront notre avenir collectif :

- Lutter contre la désinformation massive facilitée par ces technologies

- Garantir la transparence des sources et la fiabilité des informations

- Accompagner la transformation du marché du travail

- Protéger la propriété intellectuelle tout en favorisant l’innovation

- Assurer un accès équitable et durable à ces technologies puissantes

Ces défis appellent une approche équilibrée, où l’innovation technologique s’accompagne d’une réflexion éthique approfondie et de cadres réglementaires adaptés. La bonne nouvelle est que nous disposons encore d’une fenêtre d’opportunité pour orienter ces technologies vers un avenir désirable.

Comme l’a souligné la chercheuse Timnit Gebru : « L’IA générative n’est pas un phénomène naturel incontrôlable. C’est une technologie que nous développons collectivement et dont nous pouvons décider les règles et les valeurs. »

En tant que citoyens, consommateurs, créateurs ou décideurs, nous avons tous un rôle à jouer dans cette conversation cruciale. L’IA générative peut devenir un outil d’émancipation et de créativité sans précédent, à condition que nous relevions ensemble ces défis éthiques fondamentaux.

FAQ sur l’IA générative et ses défis éthiques

L’IA générative peut-elle vraiment remplacer la créativité humaine ?

Non, l’IA générative ne remplace pas la créativité humaine, mais la transforme. Ces technologies excellent dans l’imitation et la combinaison de styles existants, mais peinent encore à comprendre les nuances culturelles profondes ou à innover véritablement. Leur rôle est davantage celui d’un amplificateur de créativité humaine que d’un substitut. Les créateurs qui maîtrisent les prompts IA générative efficaces peuvent utiliser ces outils pour explorer des possibilités nouvelles tout en gardant le contrôle créatif.

Comment savoir si un contenu a été créé par une IA ?

Identifier le contenu généré par IA devient de plus en plus difficile, mais certains indices peuvent vous aider :

- Répétitions subtiles de phrases ou de motifs

- Incohérences logiques ou factuelles

- Uniformité excessive du style

- Perfection artificielle des images (mains, textures)

Des outils de détection comme Content at Scale, GPTZero ou Writer AI peuvent aider, mais leur fiabilité n’est pas parfaite. En 2025, nous verrons probablement se généraliser l’étiquetage obligatoire des contenus générés par IA, facilitant leur identification.

Les régulations actuelles sont-elles suffisantes pour encadrer l’IA générative ?

Non, les cadres réglementaires actuels sont encore inadaptés face à la rapide évolution de l’IA générative. L’Union Européenne est en avance avec son AI Act qui classe les systèmes génératifs comme « à haut risque » et impose des obligations de transparence. Aux États-Unis, la régulation reste fragmentée, tandis que la Chine a mis en place des règles strictes sur les contenus générés. Les principales lacunes concernent la responsabilité juridique pour les contenus générés, la protection contre la désinformation et les standards internationaux harmonisés.

Comment les entreprises peuvent-elles utiliser l’IA générative de façon éthique ?

Pour une utilisation éthique des applications IA générative entreprise, plusieurs bonnes pratiques s’imposent :

- Transparence : Informer clairement clients et utilisateurs quand du contenu est généré par IA

- Vérification humaine : Maintenir une supervision humaine sur les contenus critiques

- Diversité des données : S’assurer que les modèles utilisés sont entraînés sur des données diverses

- Respect des droits d’auteur : Utiliser des modèles formés légitimement

- Gouvernance claire : Établir des politiques internes d’utilisation responsable

- Formation continue : Éduquer les employés aux enjeux éthiques de ces technologies

Quels sont les risques liés à la concentration des technologies d’IA entre quelques acteurs ?

La concentration des technologies génératives entre quelques géants technologiques pose plusieurs risques majeurs :

- Monopolisation du savoir et de l’innovation

- Uniformisation des biais intégrés dans les systèmes d’IA

- Vulnérabilité des infrastructures numériques critiques

- Dépendance technologique des États et perte de souveraineté numérique

- Barrières à l’entrée pour de nouveaux acteurs innovants

Pour contrer ces risques, le développement de modèles open-source, les initiatives de fédération de données et les politiques antitrust adaptées aux réalités numériques seront essentiels dans les années à venir.